Fonte: Gartner

Q&A com Apeksha Kaushik

Uma pesquisa realizada pelo Gartner em 2025 com 302 líderes de segurança cibernética revelou que os incidentes com deepfakes estão afetando cada vez mais as organizações, com 43% relatando pelo menos um incidente com chamada de áudio e 37% vivenciando deepfakes em chamadas de vídeo. Os Chief Information Officers (CIOs) e líderes de segurança que subestimam esses riscos colocam suas companhias e carreiras em risco. No entanto, muitos ainda têm dificuldade para monitorar e proteger identidades digitais, deixando lacunas críticas em suas estratégias de segurança.

Apeksha Kaushik, Analista Principal do Gartner, comenta neste Q&A sobre como o ritmo dos ataques utilizando Inteligência Artificial (IA) está ganhando força e como os CIOs podem se defender proativamente contra essa ameaça e proteger suas organizações e suas identidades digitais.

Tópicos como esses e outros voltados a CIOs e líderes de TI e negócios, incluindo insights e tendências que moldam o futuro, como aceleração da transformação empresarial, modernização de aplicações, infraestrutura e operações, serão destaque na Conferência Gartner CIO & IT Executive 2025. O evento, que será realizado de 22 a 24 de setembro em São Paulo (SP), mostrará como a liderança e a inovação, combinadas com a adoção de tecnologias de ponta, exercem um papel fundamental nos resultados das empresas. Mais informações estão disponíveis em: https://www.gartner.com/pt-br/conferences/la/cio-brazil

– Como a IA está acelerando a disseminação da desinformação?

Campanhas de desinformação e deepfakes impulsionados por IA são cada vez mais usados por adversários para acessar dados sensíveis, interromper operações, manipular a opinião pública e obter ganhos financeiros ou políticos.

Sessenta e dois por cento das organizações sofreram pelo menos um ataque com deepfake nos últimos 12 meses que incluiu alguma forma de engenharia social ou explorou processos automatizados existentes, de acordo com a pesquisa do Gartner com líderes de segurança cibernética.

O Gartner prevê que, até 2027, os agentes de IA reduzirão pela metade o tempo necessário para explorar a apropriação de contas, dando às organizações ainda menos tempo para responder a essas ameaças. Os agentes de IA automatizarão mais etapas na cadeia de apropriação de contas, incluindo o uso de vozes via deepfake para tornar a engenharia social mais convincente e comprometer os canais de autenticação.

Os atacantes aproveitam ferramentas de Inteligência Artificial Generativa (GenAI) para criar conteúdo deepfake para lançar ataques em processos automatizados existentes (reconhecimento de voz ou rosto) ou em funcionários. Não é de surpreender que os líderes estejam preocupados. Uma pesquisa do Gartner de 2024 com 456 Chief Executive Officers (CEOs) e outros executivos seniores de negócios em todo o mundo revelou que 62% acreditam que os deepfakes criarão pelo menos alguns custos operacionais e complicações para suas organizações nos próximos três anos.

– Quais são os riscos comerciais e de liderança de ignorar a segurança contra desinformação?

Ignorar a segurança contra desinformação é uma ameaça direta à continuidade dos negócios e à credibilidade da liderança. Os líderes correm o risco de causar graves danos à reputação deles próprios e de suas organizações, minando a confiança das partes interessadas e desencadeando um escrutínio regulatório em cenários como violações de dados ou falhas de conformidade.

A superfície de ataque digital, incluindo ativos da marca, perfis de executivos e dados sensíveis, é um alvo fácil para os adversários, especialmente quando as organizações não monitoram e gerenciam proativamente seus ativos digitais como parte do gerenciamento da superfície de ataque. Ativos acessíveis ao público, como contas em redes sociais, fotos de executivos e logotipos corporativos, são especialmente vulneráveis ao uso indevido em ataques de personificação, incluindo sites falsos e conteúdo fraudulento.

Narrativas falsas sobre a empresa ou seus executivos podem se espalhar rapidamente pelas plataformas digitais, tornando quase impossível corrigir ou rastrear a origem da desinformação depois que ela se espalha.

– O que as organizações devem fazer para combater a desinformação gerada pela IA?

O Gartner prevê que, até 2027, 50% das empresas estarão investindo em produtos ou serviços de segurança contra desinformação e estratégias TrustOps, em comparação com menos de 5% atualmente.

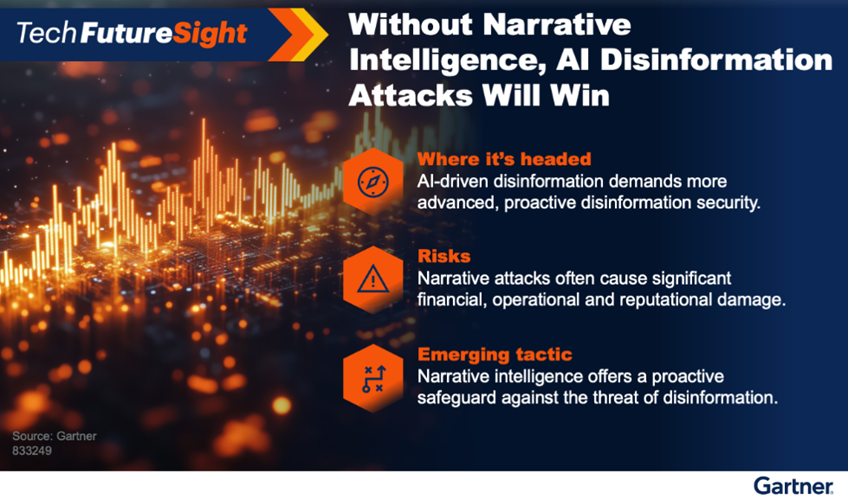

Os serviços de inteligência de ameaças e proteção contra riscos digitais (DRPS) já são componentes da segurança contra desinformação. Agora, uma tática emergente chamada inteligência narrativa está expandindo os recursos de segurança contra desinformação, oferecendo uma capacidade de defesa mais proativa.

A inteligência narrativa vai além da organização e de suas vulnerabilidades técnicas para descobrir ameaças baseadas na percepção, até mesmo latentes, pois compreende como e por que a desinformação se espalha. Ela identifica e combate campanhas de desinformação geradas por IA antes que causem danos operacionais ou à reputação. Esse monitoramento e ação preventivos são essenciais, dada a velocidade e a escala com que a IA pode gerar e distribuir desinformação.

A inteligência de narrativa é a pedra angular da segurança contra a desinformação da IA

Fonte: Gartner (Setembro 2025)

A inteligência narrativa eficaz permite que as organizações antecipem e superem as ameaças de desinformação, ganhando uma vantagem estratégica sobre concorrentes menos preparados. Ao evitar a inércia e os danos causados pela desinformação generalizada, as organizações podem proteger a percepção e a confiança em sua marca antes que ela seja atacada.

Os clientes do Gartner podem saber mais em “Emerging Tech: Defend the Digital Attack Surface With Disinformation Security” e “Tech FutureSight: Without Narrative Intelligence, AI Disinformation Attacks Will Win”.